本文最后更新于391 天前,其中的信息可能已经过时,如有错误请发送邮件到1910452164@qq.com

来自吴恩达深度学习3.6:https://www.bilibili.com/video/BV1FT4y1E74V?t=543.3&p=30

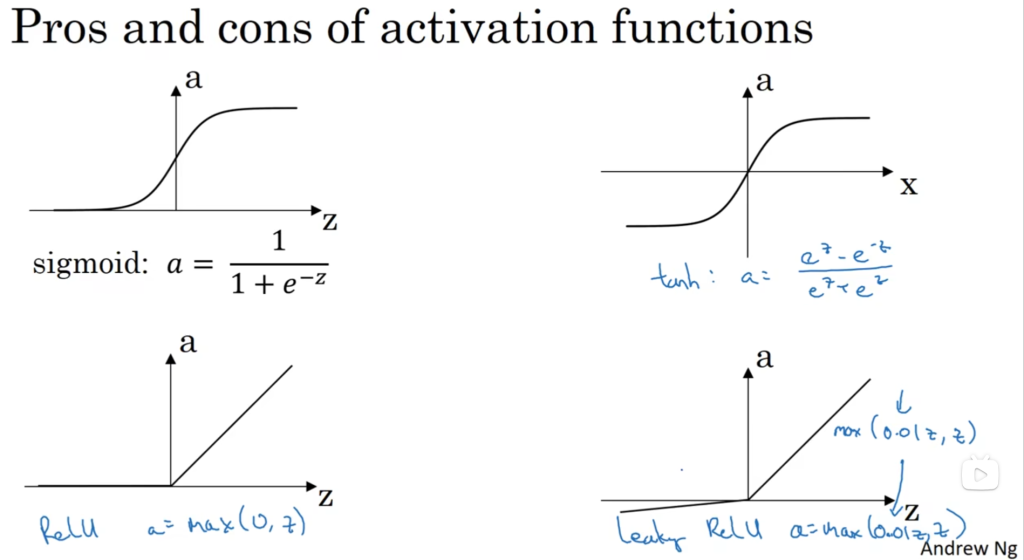

- sigmoid:值域为(0,1),几乎不用,一般只用在二元分类的输出层

- 双曲正切tanh:值域为(-1,1),各方面性能优于sigmoid

- ReLU:优先之选,解决了前两者在z值很小时斜率几乎为0的情况,这会导致梯度下降很慢

- leaky ReLU:解决了ReLU在z<0时斜率为0的问题,但是用的不多