本文最后更新于386 天前,其中的信息可能已经过时,如有错误请发送邮件到1910452164@qq.com

- 正则化的基本操作

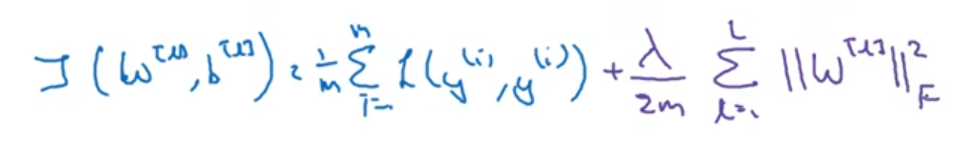

更新损失函数,引入W的L2范数

- 正则化的原理

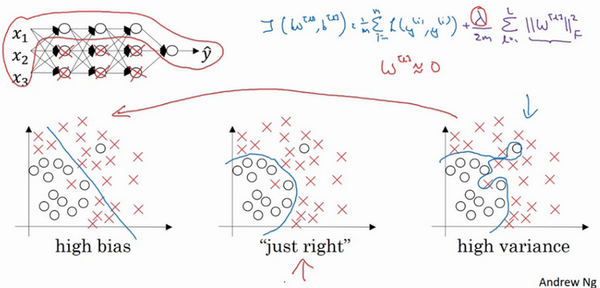

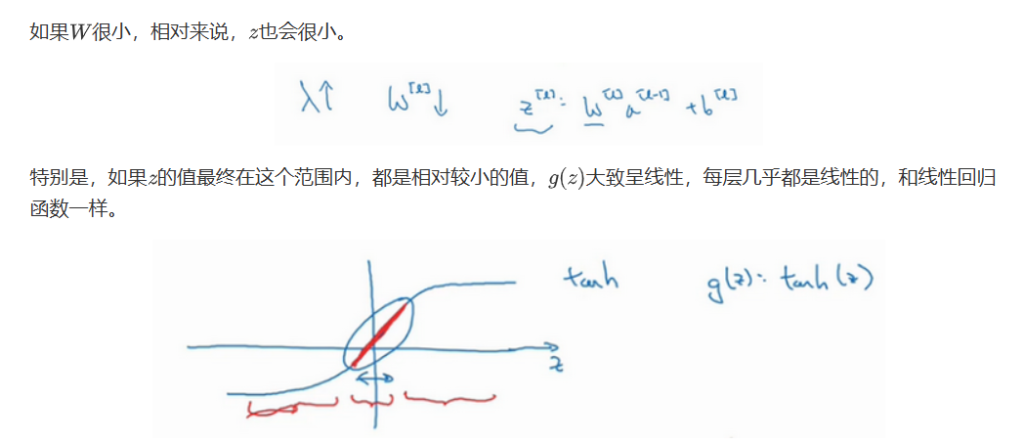

λ增加到足够大时,W会被压缩至很小,使得神经网络中的所有隐藏单元的影响变得极小,因此神经网络会变得更接近逻辑回归,更不容易发生过拟合

需要注意的是,λ会存在一个中间值,于是会有一个“中间状态”,使得模型的拟合程度最适中。

如果每层都是线性的,那么整个网络就是一个线性网络,即使是一个非常深的深层网络,因具有线性激活函数的特征,最终我们只能计算线性函数,因此,它不适用于非常复杂的决策,以及过度拟合数据集的非线性决策边界

和谐nb无人可敌